Cómo ampliar fotos al detalle a partir de imágenes con muy poca resolución

Un equipo de Google Brain logra mejorar fotografías ampliadas con escasos píxeles a través de varias técnicas de inteligencia artificial

"Amplía la foto y, ahora, mejórala" son palabras clásicas en las escenas de algunas series policíacas y de ciencia ficción para tratar de identificar a los sospechosos. Un recurso lejos de la realidad, ya que una imagen digital no puede ser ampliada sin perder información. Hasta ahora.

Google Brain, el proyecto de investigación de aprendizaje profundo de la multinacional estadounidense, ha logrado generar imágenes detalladas a partir de muestras de muy poca resolución. Apenas un conjunto de píxeles.

Recuperar una fotografía de alta resolución a partir de una muy ampliada es complicado, ya que no se dispone de la información necesaria para recrearla. Un agente que desarrolle esta tarea debe tener en cuenta varias posibilidades como el punto desde el que está hecha la foto, la iluminación de la escena, oclusión, etcétera. Cuando hay detalles que se pierden, no solo hay que limpiar y redefinir la imagen, hay que generarla.

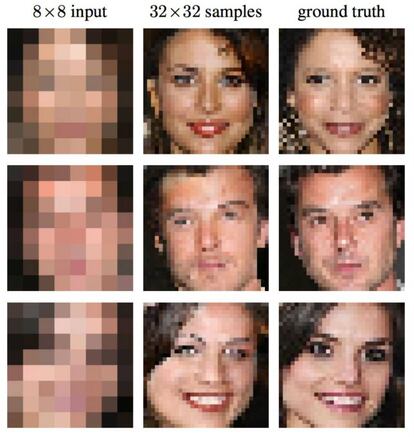

El equipo de investigadores de Google Brain entrenó a un agente artificial para generar fotografías de mayor resolución a partir de retratos de famosos o fotografías de dormitorios de apenas 64 píxeles (8x8). En estas imágenes, los detalles del pelo o la piel se pierden completamente y no pueden obtenerse ciertas peculiaridades con técnicas de interpolación empleadas comúnmente en los televisores.

Pero un artista puede generar un retrato semejante gracias al conocimiento previo que tiene al haber visto millones de rostros y sus posibles variaciones. Google Brain ha logrado crear fotografías de alta resolución gracias a dos procesos.

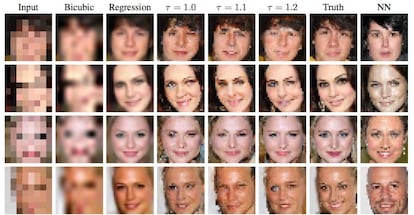

En el primero, una red de condicionamiento equipara las fotos de baja resolución con otras de alta resolución. Las semejantes se escalan a los 8x8 píxeles que el equipo ha empleado de base y se seleccionan las que concuerdan. En la figura se pueden observar varios ejemplos de retratos de famosos generados de forma artificial.

En el segundo proceso se intenta añadir detalles realistas de fotos de alta resolución a las imágenes fuente. Una red neuronal trata un gran número de fotos que sean del mismo tipo que la que se quiere mejorar y aprende las variaciones que pueden existir. En el ejemplo se emplean retratos de famosos, por lo que la red usará millones de fotos de caras. Cuando la imagen es convertida a una de mayor resolución (32x32 píxeles), los algoritmos añaden detalles basados en la probabilidad. Por ejemplo, un píxel marrón es una ceja si está encima de un ojo.

La imagen final de mayor resolución es generada a través del trabajo de las dos redes en paralelo y la fusión de ambas basada en un modelo de probabilidad. Como puede observarse en la figura, la mejora en resolución es suficiente como para identificar mejor al sujeto: se recuperan los ojos, el pelo o la boca. Se pueden generar multitud de imágenes dependiendo de su claridad y fiabilidad. Algo que el equipo ha cuantificado y representado en el estudio.

Como puede observarse en la figura, la mejora en resolución es suficiente como para identificar mejor al sujeto: se recuperan los ojos, el pelo o la boca

Los investigadores probaron la eficacia de su agente mostrando a varias personas la fotografía original y la generada artificialmente. Se les pidió elegir qué instantánea había sido tomada por una cámara y cuál generada artificialmente. El 11% de los encuestados pensó que la fotografía original era la generada por un algoritmo en el caso de los retratos de famosos y el 28% cuando se les mostraron las fotografías de dormitorios. La perfección se lograría al llegar a un 50% de probabilidad de acierto, donde el ser humano no puede distinguir —ni intuir— si una fotografía ha sido tomada con una cámara o generada por la inteligencia artificial.

La imagen resultante de la mejora de resolución no es real. Los detalles son probabilidades, pero las técnicas son útiles para identificar sujetos o detalles en ciertas fotografías que hasta ahora solo eran unos pocos píxeles.

Tu suscripción se está usando en otro dispositivo

¿Quieres añadir otro usuario a tu suscripción?

Si continúas leyendo en este dispositivo, no se podrá leer en el otro.

FlechaTu suscripción se está usando en otro dispositivo y solo puedes acceder a EL PAÍS desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripción a la modalidad Premium, así podrás añadir otro usuario. Cada uno accederá con su propia cuenta de email, lo que os permitirá personalizar vuestra experiencia en EL PAÍS.

¿Tienes una suscripción de empresa? Accede aquí para contratar más cuentas.

En el caso de no saber quién está usando tu cuenta, te recomendamos cambiar tu contraseña aquí.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrará en tu dispositivo y en el de la otra persona que está usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquí los términos y condiciones de la suscripción digital.